Згідно з новим звітом гіганта кібербезпеки CrowdStrike, розвиток генеративних інструментів штучного інтелекту, таких як ChatGPT, збільшив потенціал для широкого кола зловмисників, щоб націлитися на вибори по всьому світу в 2024 році.

Згідно зі щорічним глобальним звітом компанії про глобальні загрози, як пов’язані з державою хакери, так і пов’язані з ними так звані «хактивісти» все частіше експериментують із ChatGPT та іншими інструментами штучного інтелекту, що дозволяє ширшому колу учасників здійснювати кібератаки та шахрайство. Це стосується хакерів, пов’язаних із Росією, Китаєм, Північною Кореєю та Іраном, які випробовують нові способи використання цих технологій проти США, Ізраїлю та європейських країн.

У зв’язку з тим, що у 2024 році половина населення світу буде голосувати, використання генеративного штучного інтелекту для націлювання на вибори може стати «великим чинником», — каже Адам Мейерс, керівник відділу протидії ворожим операціям CrowdStrike. Наразі аналітики CrowdStrike змогли виявити використання цих моделей за допомогою коментарів у сценаріях, які були б розміщені там за допомогою такого інструменту, як ChatGPT. Але, попереджає Мейєрс, «це буде погіршуватися протягом року».

Якщо пов’язані з державою суб’єкти продовжуватимуть покращувати використання штучного інтелекту, «це справді демократизує можливість проводити високоякісні кампанії з дезінформації» та пришвидшить темп, з яким вони зможуть здійснювати кібератаки, каже Мейерс.

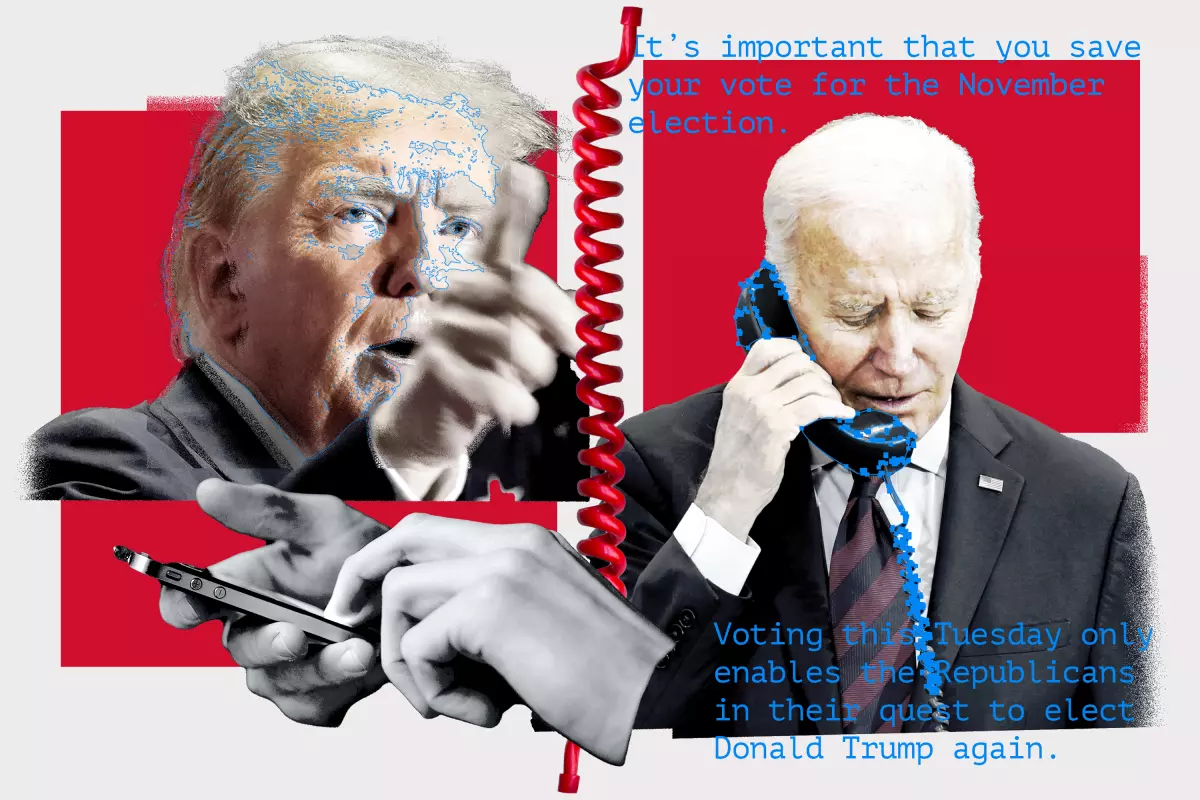

«Враховуючи легкість, з якою інструменти штучного інтелекту можуть генерувати оманливі, але переконливі наративи, супротивники, швидше за все, використовуватимуть такі інструменти для проведення [інформаційних операцій] проти виборів у 2024 році», — кажуть автори звіту. «Політично активні сторонники в тих країнах, де проводяться вибори, також, ймовірно, використовуватимуть генеративний ШІ для створення дезінформації для поширення у своїх колах».

Решта статті була заблокована. Щоб продовжити читання, увійдіть.